- Accueil

- Actu

- Justice et faits divers

- Christchurch : le Conseil français du culte musulman porte plainte contre Facebook et YouTube

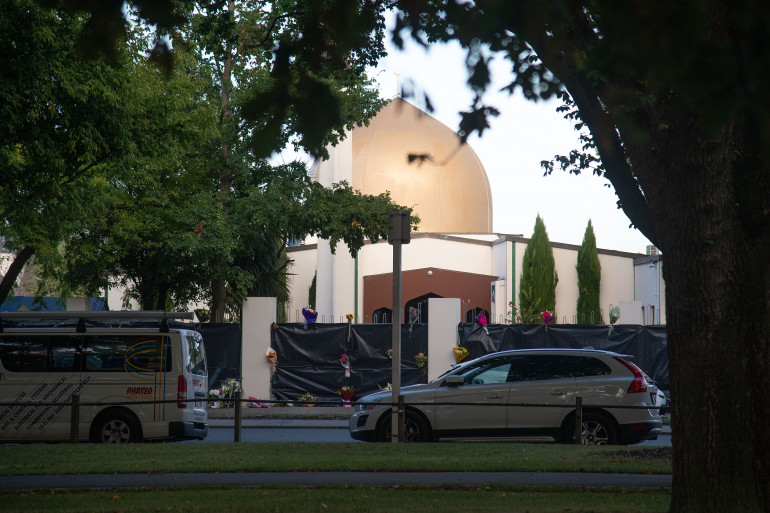

Christchurch : le Conseil français du culte musulman porte plainte contre Facebook et YouTube

Dix jours après le massacre de Christchurch en Nouvelle-Zélande qui a fait 50 morts, le Conseil français du culte musulman porte plainte contre Facebook et Youtube, qui ont diffusé les vidéos de l'auteur.

Le Conseil français du culte musulman (CFCM) a annoncé ce lundi 25 mars qu'il portait plainte contre Facebook France et Youtube France pour avoir diffusé la vidéo du massacre de 50 fidèles à Christchurch, en Nouvelle Zélande par Brenton Tarrant, un extrémiste australien âgé de 28 ans.

Le CFCM porte plainte pour "diffusion de message à caractère violent incitant au terrorisme ou de nature à porter gravement atteinte à la dignité humaine susceptible d'être vu ou perçu par un mineur", selon la plainte envoyée lundi au procureur de la République de Paris. Des faits punis de trois ans d'emprisonnement et de 75.000 euros d'amende.

Le terroriste a diffusé son massacre en direct sur Facebook, dans une vidéo longue de 17 minutes, passant outre les systèmes de contrôle du réseau social. Le document s'est ensuite propagé sur de nombreux sites, notamment YouTube, Instagram (propriété de Facebook) et Twitter, dans son intégralité ou via des extraits. De nombreux internautes à travers le monde entier ont été choqués de cette large diffusion et se sont interrogés sur l'efficacité des outils de modérations des réseaux sociaux.

Le CFCM pointe le "manque de célérité" de Facebook

La séquence a été vue par 4.000 personnes avant d'être supprimée, selon Facebook, et aucun de ces spectateurs ne l'a immédiatement dénoncée. C'est seulement 29 minutes après le début de la diffusion, sur un signalement de la police néo-zélandaise, que la vidéo a été retirée, sans empêcher une très large rediffusion ensuite.

Une durée que fustige le CFCM, qui affirme "des mineurs ont eu accès à ce film, et notamment (...) de confession musulmane", faisant valoir que les jeunes spectateurs ont été traumatisés. Le Conseil estime que ce "défaut de célérité" de la part de Facebook serait également responsable de la publication de la vidéo sur Youtube.

Facebook admet une faille dans son système de détection

Mercredi dernier, le vice-président de Facebook Guy Rosen s'est expliqué longuement sur son site, en donnant des détails sur le fonctionnement de la modération sur la plateforme aux 2 milliards d'utilisateurs. "Nos systèmes d'intelligence artificielle s'entraînent avec des données, ce qui implique le traitement de milliers d'exemples pour détecter un certain type de texte, d'image ou de vidéo (...) Cependant, cette vidéo en particulier n'a pas éveillé l'attention de nos systèmes de détection automatique", a t-il souligné.

Dans les 24H suivant l'attaque, Facebook a retiré 1,5 million de copies de la vidéo. De son côté, Google, maison mère de YouTube, n'a pas souhaité faire de commentaire. La semaine dernière, des parlementaires américains ont demandé aux dirigeants de quatre géants de l'internet - Facebook, YouTube, Twitter, Microsoft - de venir s'expliquer sur la prolifération en ligne de cette vidéo, alors même que les géants du Web ont créé, en 2017, un Forum mondial de l'internet contre le terrorisme (GIFTC) afin d'agir contre les contenus de ce type.

Commentaires

Afin d'assurer la sécurité et la qualité de ce site, nous vous demandons de vous identifier pour laisser vos commentaires.

Cette inscription sera valable sur le site RTL.fr.